動き回るピンポン玉をロックオン,1本1本の毛を自在に制御...製品化前のコンテンツ技術を披露 ―― デジタルコンテンツEXPO 2013

●別録りした音と映像を編集することなくリアルタイムに同期再生

早稲田大学理工学術院 基幹理工学部表現工学科 音コミュニケーション科学研究室は,映像と音声を別々に収録した未編集のコンテンツを,音声を基準にしてリアルタイムに同期再生するシステムを展示した(写真7).

写真7 音コンテンツをスピーカで再生し,その音に基づいてパソコンの映像コンテンツを同期表示する

音響映像のコンテンツを作成する場合,ビデオ・カメラによる録画とは別に,音声は専用機器で録音することが多い.通常は録画データと録音データに同期信号(タイムコード)を入力することで映像と音の同期を図っているが,近年は同期を取らずに収録を行うケースも増えているという.そのような場合,通常,詳細な編集作業を行うことで映像と音を同期するのだが,作業が煩雑で手間がかかる.そこで,映像にも同じ音が収録されていることに着目し,音声信号を基準としてリアルタイムに映像と音を合わせ,その場での同期を実現したのが本技術である.スピーカから流れる音のみで同期処理を行えるので,機材同士をケーブルでつなぐ必要はない.

処理の流れとしては,まず収録された音源をプレーヤで再生し,その音を映像が保存・再生されているコンピュータに,マイク入力を使って取り込む.取り込まれた音と映像に含まれる音声信号とを比較し,同一の音が鳴っている個所を検出する.そして,動画の再生位置を,検出された音声の位置に移動させることで映像と音の同期再生を行うのである.

この技術の肝は音の検出にある.リアルタイム処理を行うため,データ比較の計算を高速に行わなくてはならない.本技術では,人が楽器の鳴り始めや激しい音の強弱といった変化が大きい個所を印象として記憶する点に注目し,情報量が多く特徴的な値のみを抽出することでデータ量を削減し,高速に計算できるようにした.具体的には,音の立ち上がりに着目し,一定時間ごとに周波数スペクトルの変化を追い,時間あたりの変化が最も大きい周波数を抽出するようにしたという.

本技術の最大の特徴は,音の成分の変化を比較するため,雑音に強く周囲の音に影響されにくい点にある.また,音量が小さくても同期する.さらに,音を基準とするために,複数の映像再生装置(パソコンなど)で独立に動作できる.例えば,マルチアングルの映像を複数同期することも可能だ.

説明員によると,映像アーカイブの中から音源を元にリアルタイム検索するシステムのアイデアが本システム開発のきっかけになったということだった.

●インターネットを使って学習する人工知能をロボットに搭載

東京工業大学 長谷川修研究室は,過去に自身で行った動作を記憶蓄積した情報やインターネットを活用し解決策を見出していく自己増殖型ニューラル・ネットワーク人工脳「SOINN(Self-Organizing Incremental Neural Network)」を搭載したロボットを展示した(写真8).

写真8 自己増殖型ニューラルネットワーク「SOINN」を搭載したロボット

「SOINN」は,自分で考えて行動するロボットの構築を目指して考案された学習手法である.未知の状況(知識)に遭遇した場合,インターネットを使って画像や音,動画などの情報を自ら検索し,それを学習していくことで解決策に到達する.「SOINN」を導入することで,プログラムされた一定の行動しかできなかったロボットが,自律的に行動するようになるという.

デモンストレーションとして,「SOINN」を搭載したロボットに「冷たいマテ茶を注ぐ」という一連の動作を行わせてみせた.デモンストレーションは,あらかじめ決められた質問項目に沿って行われるため,純粋に未知の状況に遭遇した場合の動作とはいえないが,音声認識やカメラによる対象物の画像認識,センサ類による握力の調整や重さ,傾きの判断処理,経験則の適用などを見る限り,かなりの精度と制御能力の高さを持っていることがうかがわれた.

本技術の特徴として,事前のモデル設定や知識データベースの入力などが不要という点が挙げられる.分からない場合はオンライン検索を行い,追加的に学習していくためだ.さらに,インターネットなどの膨大なデータの中からノイズを除去し,対象を区別,抽出できる.抽出した情報を起点とした連想や推論,知識転移といった高次レベルの知能情報処理も「SOINN」単独で行え,さらに,過去に行った動作を蓄積したり,経験として組み合わせて行動することも可能.これらの計算処理は軽量で,動作も高速に行われるとのことだ.

なお本技術は,「特に環境分野への波及・応用が期待される技術」として「Innovative Technologies 2013 特別賞」を受賞した.

●指先に当てるだけでうつ傾向がわかる?! スマホ用判定アプリ

首都大学東京 IDEEA.Lab(串山・馬場研究室)は,生体情報を利用したスマートフォン用うつ傾向判定アプリ「Utsukamo」を展示した(写真9).

写真9 スマホ用うつ傾向判定アプリ「Utsukamo」

スマホの背面カメラのレンズ部分に人差し指の先をかぶせるように当てて光源にかざし,後はアプリをスタートさせるだけだ.判定の流れの中で音楽を聴く必要があるので,あらかじめヘッドホンを装着しておく.アプリがスタートすると,まず,1回目の脈拍の計測が始まる.指先がライトに透かされ,1分間の血管の動きが情報として取り込まれる.そのデータから,心拍数変動指標という心拍のゆらぎに関するデータが導き出されるという.計測が終わったら,リラックスするための映像と音楽を数分間鑑賞する.そして,2回目の脈拍の計測を1分間行う.その後,うつ傾向の判定結果が表示されるという具合だ.

通常,健康な人はリラックスする映像や音楽を視聴すると副交感神経が活性化するが,うつ傾向の人は逆になることが多いという.「Utsukamo」は,得られた心拍数変動指標と特別な計測手法を使って,映像・音楽鑑賞前後の副交感神経の活性度を比較し,「うつ」傾向の判定を行っているのだそうだ.うつ傾向の判定として一般的に行われている,主観的なアンケートによらない新たな手法ということができる.

この展示バージョンの結果は参考程度ということだが,心拍数変動指標の計算などは,実際に病院で使われているものと同様のプログラムを利用しているとのことである.今のところ,「Utsukamo」を一般に配布する予定はないそうだが,ディジタル・コンテンツとして健康に関連するカテゴリは今後も注目を集める分野といえる.

●インタラクティブに動作する2次元の映像キャラクタを実空間に投影

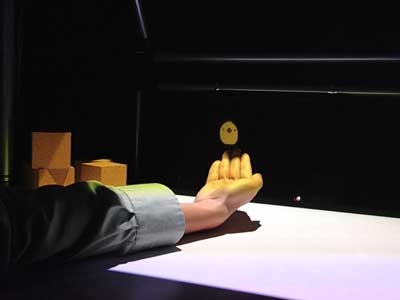

東京大学 苗村研究室は,2次元の映像キャラクタを実空間に投影,結像させ,ユーザとの間でインタラクティブに動作させることができるインターフェース「でるキャラ」を展示した(写真10).

写真10 2次元映像キャラクタが手に飛び乗ってくる「でるキャラ」

本システムは,空中像ディスプレイと深度センサ,プロジェクタなどから構成されている.キャラクタが出現するステージの奥側に45度の角度で実像鏡が取り付けられており,その下に上下動を行うアクチュエータが付いたディスプレイが設置されている(写真11).これが空中像ディスプレイ部分で,ディスプレイの映像が,実像鏡を通して手前ステージ上の35cm(横)×25cm(高さ)×30cm(奥行き)の空間内に投影されるようになっているのだ.

写真11 空中像ディスプレイ部分

上下動を行うディスプレイに表示されたひよこが,実像鏡を通してステージ上に投影されるしくみ.

ステージ上にある障害物(ブロック,手など)の位置や形状を,ステージ上方に設置した深度センサで計測し,この計測情報によって,2次元映像キャラクタの空中像の表示位置を決めている(例えば,ブロックをどけて手を差し込むと,2次元映像キャラクタであるひよこは手の上に飛び乗ってくる).さらに,ステージ上部に設置したプロジェクタから,2次元映像キャラクタ用の影を投影している.影を出すことで,本来は実体のない2次元映像キャラクタに実在感が出てくる.

いその・やすたか